题目内容

(请给出正确答案)

题目内容

(请给出正确答案)

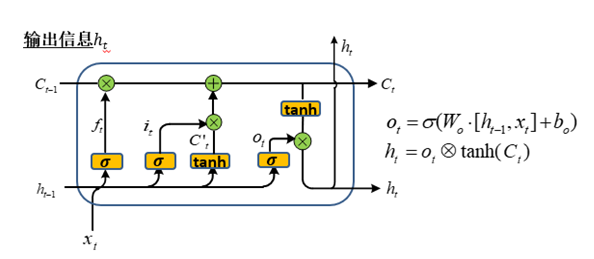

下列关于LSTM说法正确的是

A.LSTM用三个控制门记忆长期状态

B.忘记门控制保存之前的长期状态

C.输入门控制更新长期状态

D.输出门控制是否把长期状态作为当前的LSTM的输出

参考答案

参考答案

简答题官方参考答案

(由简答题聘请的专业题库老师提供的解答)

简答题官方参考答案

(由简答题聘请的专业题库老师提供的解答)

网友提供的答案

网友提供的答案

- · 有5位网友选择 C,占比41.67%

- · 有3位网友选择 D,占比25%

- · 有2位网友选择 B,占比16.67%

- · 有2位网友选择 A,占比16.67%

题目内容

(请给出正确答案)

题目内容

(请给出正确答案)

A.LSTM用三个控制门记忆长期状态

B.忘记门控制保存之前的长期状态

C.输入门控制更新长期状态

D.输出门控制是否把长期状态作为当前的LSTM的输出

参考答案

参考答案

简答题官方参考答案

(由简答题聘请的专业题库老师提供的解答)

简答题官方参考答案

(由简答题聘请的专业题库老师提供的解答)

网友提供的答案

网友提供的答案

更多“下列关于LSTM说法正确的是”相关的问题

更多“下列关于LSTM说法正确的是”相关的问题

A、双向网络假设当前步的输出只与前面的序列有关,而与后面的序列无关

B、双向网络假设当前步的输出与前面的序列无关,而与后面的序列有关

C、双向网络假设当前步的输出既与前面的序列有关,也与后面的序列有关

D、Bidirectional RNNs由两个RNNs上下叠加组成。输出由这两个RNNs的隐藏层的状态决定

A、多对多的同步序列输入输出。如词性标注等

B、多对一的处理,如判断一段文字的情感分类

C、多对多的非同步序列输入和序列输出,如机器翻译中输入英文语句然后翻译为法语形式输出

D、一对多的序列输出。如输入一张图片,生成输出一段文字序列

A、实现水平方向边缘检测

B、实现竖直方向边缘检测

C、实现45度边缘检测

D、实现图像对比度检测

A、1, 500, 000

B、1, 500, 050

C、500, 000

D、1, 500, 001

下面关于计算LSTM中的输出ht 的描述中错误的是

A、输出门的输入是 和

和 。并经过sigmoid层处理得到

。并经过sigmoid层处理得到

B、把长期状态通过 tanh 层进行处理(得到一个在 -1 到 1 之间的值),并将它和sigmoid 门的输出相乘,目的是对输出的信息加以控制

C、长期状态通过 tanh 层进行处理,然后经输出门过滤,得到要输出的

D、从图中可见,输出的信息为 与当前的输入

与当前的输入 无关

无关

A、既然有了长期状态c,就不再需要隐藏状态h了

B、长期状态c和隐藏状态h都需要被用到

C、在计算当前时刻的输出时,直接利用到的是隐藏状态h

D、在计算当前时刻的输出时,直接利用到的是长期状态c

A、实现水平方向边缘检测

B、实现竖直方向边缘检测

C、实现45度边缘检测

D、实现图像对比度检测

A、2500

B、2600

C、7500

D、7600

A、卷积神经网络的层与层之间都是全连接网络

B、卷积神经网络的层与层之间都是部分连接网络

C、卷积神经网络的层与层之间既有可能是全连接,也有可能是局部连接。通常是开始的若干层是局部连接,最后的层是全连接

D、卷积神经网络的层与层之间既有可能是全连接,也有可能是局部连接。通常是开始的若干层是全连接,最后的层是局部连接

A、从开始的层到后面的层,经过变换得到的特征图的尺寸逐渐变大

B、从开始的层到后面的层,经过变换得到的特征图的尺寸逐渐变小

C、从开始的层到后面的层,经过变换得到的特征图的尺寸大小不变

D、从开始的层到后面的层,经过变换得到的特征图的尺寸开始变小,后来变大

警告:系统检测到您的账号存在安全风险

警告:系统检测到您的账号存在安全风险

为了保护您的账号安全,请在“简答题”公众号进行验证,点击“官网服务”-“账号验证”后输入验证码“”完成验证,验证成功后方可继续查看答案!