题目内容

(请给出正确答案)

题目内容

(请给出正确答案)

当数据集的原始维度和数据集内在的本征维度相同时,使用PCA进行降维,降维后的数据不会丢失重要的信息。

简答题官方参考答案

(由简答题聘请的专业题库老师提供的解答)

简答题官方参考答案

(由简答题聘请的专业题库老师提供的解答)

抱歉!暂无答案,正在努力更新中……

抱歉!暂无答案,正在努力更新中……

题目内容

(请给出正确答案)

题目内容

(请给出正确答案)

简答题官方参考答案

(由简答题聘请的专业题库老师提供的解答)

简答题官方参考答案

(由简答题聘请的专业题库老师提供的解答)

抱歉!暂无答案,正在努力更新中……

抱歉!暂无答案,正在努力更新中……

更多“当数据集的原始维度和数据集内在的本征维度相同时,使用PCA进行降维,降维后的数据不会丢失重要的信息。”相关的问题

更多“当数据集的原始维度和数据集内在的本征维度相同时,使用PCA进行降维,降维后的数据不会丢失重要的信息。”相关的问题

A.PCA对高维数据降维后的维数是与原始数据特征维度相关(与数据类别标签无关)

B.LDA降维后所得到维度是与数据样本的类别个数K有关(与数据本身维度无关)

C.假设原始数据一共有K个类别,那么LDA所得数据的降维维度小于或等于K−1

D.PCA和LDA均是基于监督学习的降维方法

A.中心化数据集-计算协方差矩阵-计算特征根-计算主成分矩阵-得到降维后的数据集

B.中心化数据集-计算主成分矩阵-计算协方差矩阵-计算特征根-得到降维后的数据集

C.计算协方差矩阵-计算主成分矩阵-计算特征根-中心化数据集-得到降维后的数据集

D.计算协方差矩阵-计算特征根-中心化数据集-计算主成分矩阵-得到降维后的数据集

A、主成份分析方法是一种保证数据被投影后方差最大的特征降维方法

B、在主成份分析的降维过程中,尽可能将数据向方差最大方向进行投影,使得数据所蕴含信息没有丢失,彰显个性

C、特征人脸方法是一种应用主成份分析来实现人脸图像降维的方法,其本质是用一种称为“特征人脸(eigenface)”的特征向量按照线性组合形式来表达每一张原始人脸图像,进而实现人脸识别

D、假设原始灰度人脸图像维度是n*n,则特征人脸的维度是其一半

A.LDA和PCA的共同点是,都可以将原始的样本映射到维度更低的样本空间

B.LDA是为了让映射后的样本有最好的分类性能。即LDA是一种有监督的降维方法

C.PCA是为了让映射后的样本具有最大的发散性,即PCA是一种无监督的降维方法

D.LDA和PCA都是有监督的降维方法

A.主成份分析是一种特征降维方法

B.主成分分析可保证原始高维样本数据被投影映射后,其方差保持最大

C.在主成分分析中,将数据向方差最大方向进行投影,可使得数据所蕴含信息没有丢失,以便在后续处理过程中各个数据“彰显个性”

D.在主成分分析中,所得低维数据中每一维度之间具有极大相关度

A、import matplotlib.pyplot as plt

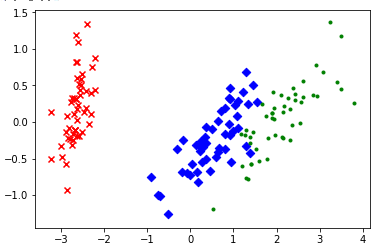

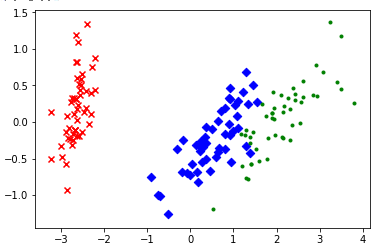

B、from sklearn.decomposition import PCA

C、from sklearn.datasets import load_iris

D、from sklearn.feature_extraction.text import CountVectorizer

A、import matplotlib.pyplot as plt

B、from sklearn.decomposition import PCA

C、from sklearn.lda import LDA

D、import numpy as np

A.特征归一化的目的是近似地均衡每维特征的影响,使每个维度上的特征在距离计算中有近似相同的作用。

B.对数据集进行min-max标准化会将每个维度上的特征值变换到相同的取值范围内。

C.对某一维度的特征进行z-score标准化后,该维度特征的均值为0,方差为1。

D.特征归一化在任何的数据集上都是适用的

警告:系统检测到您的账号存在安全风险

警告:系统检测到您的账号存在安全风险

为了保护您的账号安全,请在“简答题”公众号进行验证,点击“官网服务”-“账号验证”后输入验证码“”完成验证,验证成功后方可继续查看答案!