题目内容

(请给出正确答案)

题目内容

(请给出正确答案)

在存在AR(1)自相关的情形下,什么估计方法能够产生BLUE估计量?简述这个方法的具体步骤。

在存在AR(1)自相关的情形下,什么估计方法能够产生BLUE估计量?简述这个方法的具体步骤。

简答题官方参考答案

(由简答题聘请的专业题库老师提供的解答)

简答题官方参考答案

(由简答题聘请的专业题库老师提供的解答)

题目内容

(请给出正确答案)

题目内容

(请给出正确答案)

在存在AR(1)自相关的情形下,什么估计方法能够产生BLUE估计量?简述这个方法的具体步骤。

简答题官方参考答案

(由简答题聘请的专业题库老师提供的解答)

简答题官方参考答案

(由简答题聘请的专业题库老师提供的解答)

更多“在存在AR(1)自相关的情形下,什么估计方法能够产生BLUE估计量?简述这个方法的具体步骤。”相关的问题

更多“在存在AR(1)自相关的情形下,什么估计方法能够产生BLUE估计量?简述这个方法的具体步骤。”相关的问题

A、用OLS估计得到的模型残差对其一阶滞后进行回归,一阶滞后的参数估计量作为ρ的估计量。

B、通过DW统计量来计算,即r=1-DW/2。

C、直接计算模型残差与其一阶滞后的简单相关系数。

D、用被解释变量与其一阶滞后回归,一阶滞后的参数估计量作为ρ的估计量。

及AR(1)模式

于是科克伦和奥克特推荐如下步腺来估计ρ。

(1)用通常的OLS方法估计方程①并得到残差ut。顺便指出,你可以在模型中包含不止一个X变量。

(2)利用第1步得到的残差做如下回归:

这是方程②在实证中的对应表达式。

(3)利用方程③中得到的 ,估计广义差分方程(129.6)。

,估计广义差分方程(129.6)。

(4)由于事先不知道方程③中得到的 是不是ρ的最佳估计值,所以把第3步中得到的

是不是ρ的最佳估计值,所以把第3步中得到的 值代入原回归①,并得到新的残差解

值代入原回归①,并得到新的残差解 为

为

(5)现在估计如下回归

它类似于方程③,并给出p的第二轮估计值。由于我们不知道p的第二轮估计值是不是真实p的最佳估计值,所以我们进入第三轮估计,如此等等。这正是科克伦-奧克特程序被称为迭代程序的原因。我们该把这种(愉快的)轮回操作进行到什么程度呢?一般的建议是,当p的两个相邻估计值相差很小(比如不是0.01或0.005)时,便可停止迭代。在工资-生产率一例中,在停止之前约需要3次迭代。

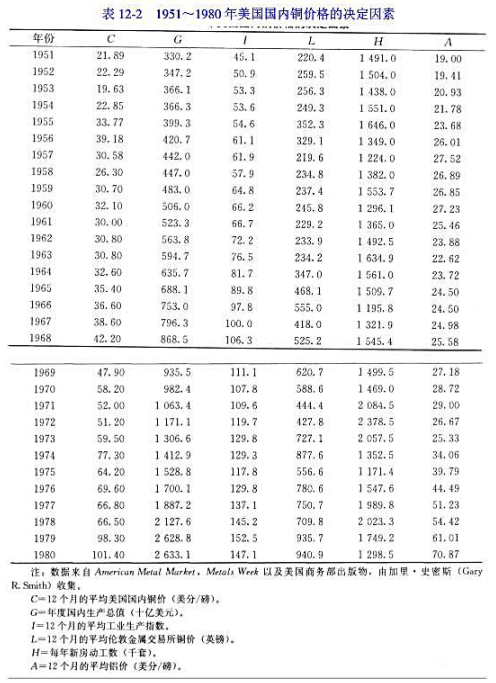

a.利用科克伦-奥克特迭代程序,估计工资生产率回归(12.5.2)的p.在得到ρ的“最终”估计值之前需要多少次迭代?

b.利用a中得到的p的最终估计值,在去掉第一次观测和保留第一次观测的情况下,估计工资生产率回归。结果有何差异?

c.你认为在变换数据以解决自相关问题时保留第一次观测重要吗?

A、德宾-沃森d统计量的取值在-1和+1之间。

B、德宾-沃森d检验假定误差项具有同方差性。

C、德宾-沃森d检验只能检验一阶序列相关。

D、序列相关违背的是关于随机干扰项和解释变量的假定

(1)a.根据这些数据,估计以下回归模型: ,并解释所得结果。

,并解释所得结果。

b.求出上述回归的残差和标准化残差并作图。你能对这些残差中是否有自回归做些什么猜测?

c.估计德宾-沃森d统计量并对数据中可能出现的自相关性质作出评论。

d.做游程检验,看你的答案是否不同于刚才在c中所得到的结果。

e.你怎样辨别AR(p)过程是否比AR(1)过程更好地描述自相关?

(2)如果该题的结果表明存在序列相关:

a.用科克伦-奥克特两步程序,估计可行GLS或广义差分回归,并比较你所得的结果。

b.如果估计自a的科克伦-奥克特法的ρ值和从d统计量估计得的结果相差较大,你将选择哪一个估计ρ的方法,为什么?

(1)Yt=α1Xt+μt

(2)Yt=α1Xt+β1Xt-1+μt

(3)Yt=β1Yt-1+μt

(4)Yt=β1Yt-1+α1Xt-1+μt

(5)Yt=α0+β1Xt+α1Xt-1+μt

经济理论指出,家庭消费支出Y不仅取决于可支配收入X1,还决定于个人财富X2,即可设定如下回归模型:

Yi=β0+β1X1i+β2X2i+μi

试根据表4-13的资料进行回归分析,并说明估计的模型是否可靠,给出你的分析。

表4-13单位:元

|

警告:系统检测到您的账号存在安全风险

警告:系统检测到您的账号存在安全风险

为了保护您的账号安全,请在“简答题”公众号进行验证,点击“官网服务”-“账号验证”后输入验证码“”完成验证,验证成功后方可继续查看答案!