题目内容

(请给出正确答案)

题目内容

(请给出正确答案)

下面关于信息熵的描述中错误的是:

A.热力学中的热熵是表示分子状态混乱程度的物理量。信息熵概念的提出受到了热力学中的热熵的概念的启发

B.信息熵由Shannon提出,信息熵的概念可以用来描述信源的不确定度

C.信息熵是通信领域的概念,和机器学习以及深度学习无关

D.在深度学习中,经常使用交叉熵来表征两个变量概率分布P, Q(假设P表示真实分布, Q为模型预测的分布)的差异性。

参考答案

参考答案

简答题官方参考答案

(由简答题聘请的专业题库老师提供的解答)

简答题官方参考答案

(由简答题聘请的专业题库老师提供的解答)

网友提供的答案

网友提供的答案

- · 有3位网友选择 A,占比33.33%

- · 有3位网友选择 D,占比33.33%

- · 有2位网友选择 B,占比22.22%

- · 有1位网友选择 C,占比11.11%

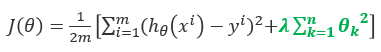

则下列说法正确的有

则下列说法正确的有